A Ollama, conhecida por permitir a execução de modelos de inteligência artificial localmente no seu computador, acaba de lançar uma muito aguardada aplicação de desktop para macOS e Windows. Esta novidade elimina a necessidade de utilizar a linha de comandos, abrindo as portas da IA local a um público muito mais vasto e menos técnico.

Uma interface gráfica para todos

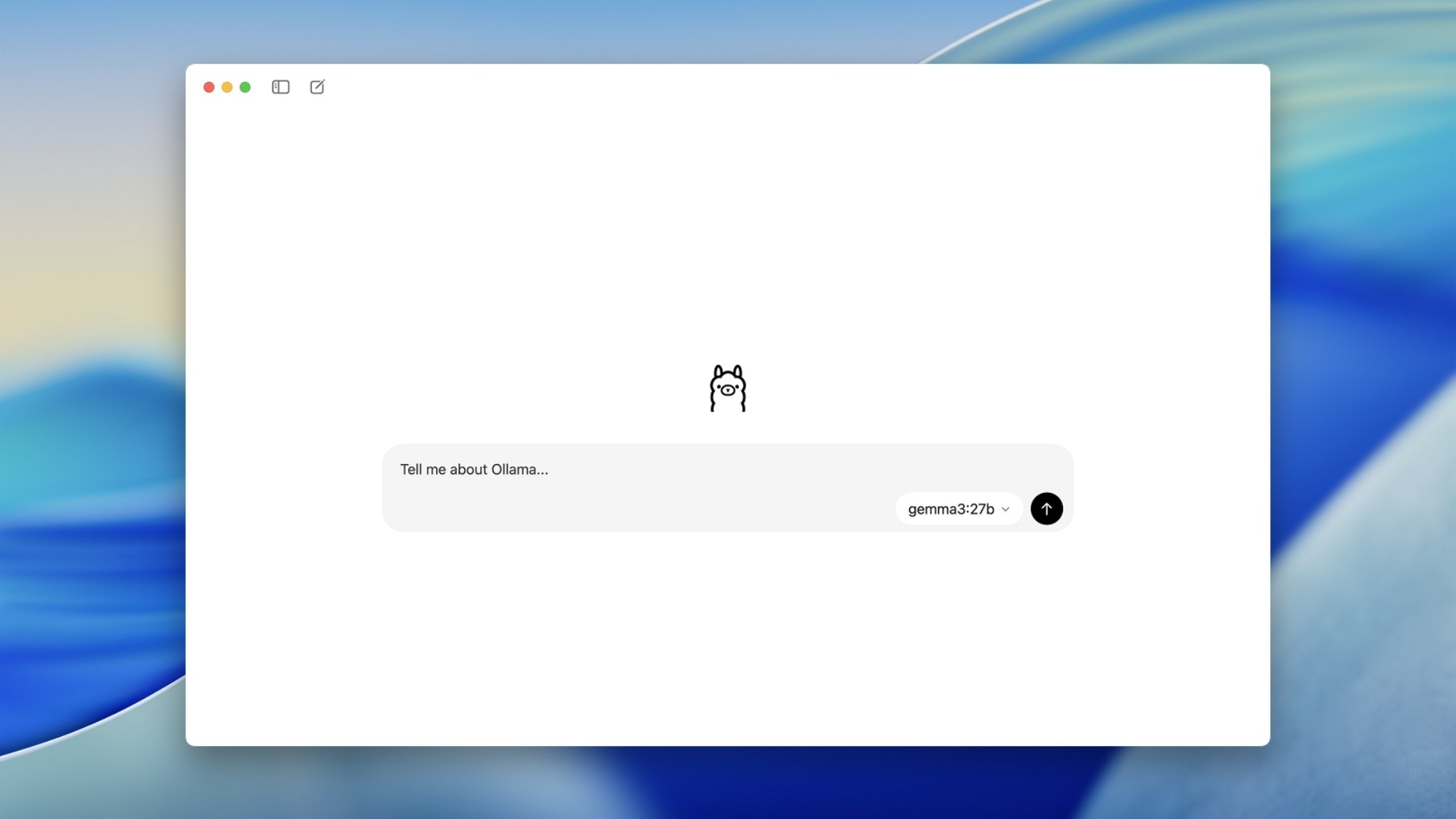

Até agora, interagir com os modelos de IA da Ollama exigia conhecimentos de terminal, o que representava uma barreira para muitos utilizadores. Com a nova aplicação, o processo é simplificado drasticamente. Basta descarregar a aplicação, escolher e baixar os modelos desejados e começar a interagir através de uma interface de chat familiar, escrevendo prompts de texto como em qualquer outra plataforma de IA.

Funcionalidades chave da nova aplicação

A nova ferramenta não é apenas uma cara bonita para a tecnologia existente; traz consigo um conjunto de funcionalidades que melhoram significativamente a experiência de utilização.

Arrastar e largar: É possível arrastar ficheiros de texto e PDFs diretamente para a aplicação para que sejam analisados pelos modelos.

Contexto ajustável: Para lidar com documentos mais longos, os utilizadores podem ajustar o comprimento do contexto nas definições, embora a Ollama avise que aumentar este valor pode resultar num maior consumo de memória RAM.

Análise de código: A aplicação consegue ler ficheiros de código, permitindo que os modelos ajudem em tarefas de compreensão, revisão e documentação de software.

Suporte multimodal: Já é possível enviar imagens para modelos compatíveis, como o Gemma 3 da Google DeepMind, permitindo interações mais ricas e contextuais.

Para os puristas, a linha de comandos continua viva

Apesar do foco na nova interface gráfica, a Ollama não esqueceu os seus utilizadores mais avançados. As ferramentas de linha de comandos (CLI) que deram origem ao projeto continuam a ser desenvolvidas e estão disponíveis para download no GitHub oficial.

Para mais detalhes sobre esta nova fase do projeto, pode consultar o anúncio no blog da Ollama.

Nenhum comentário

Seja o primeiro!