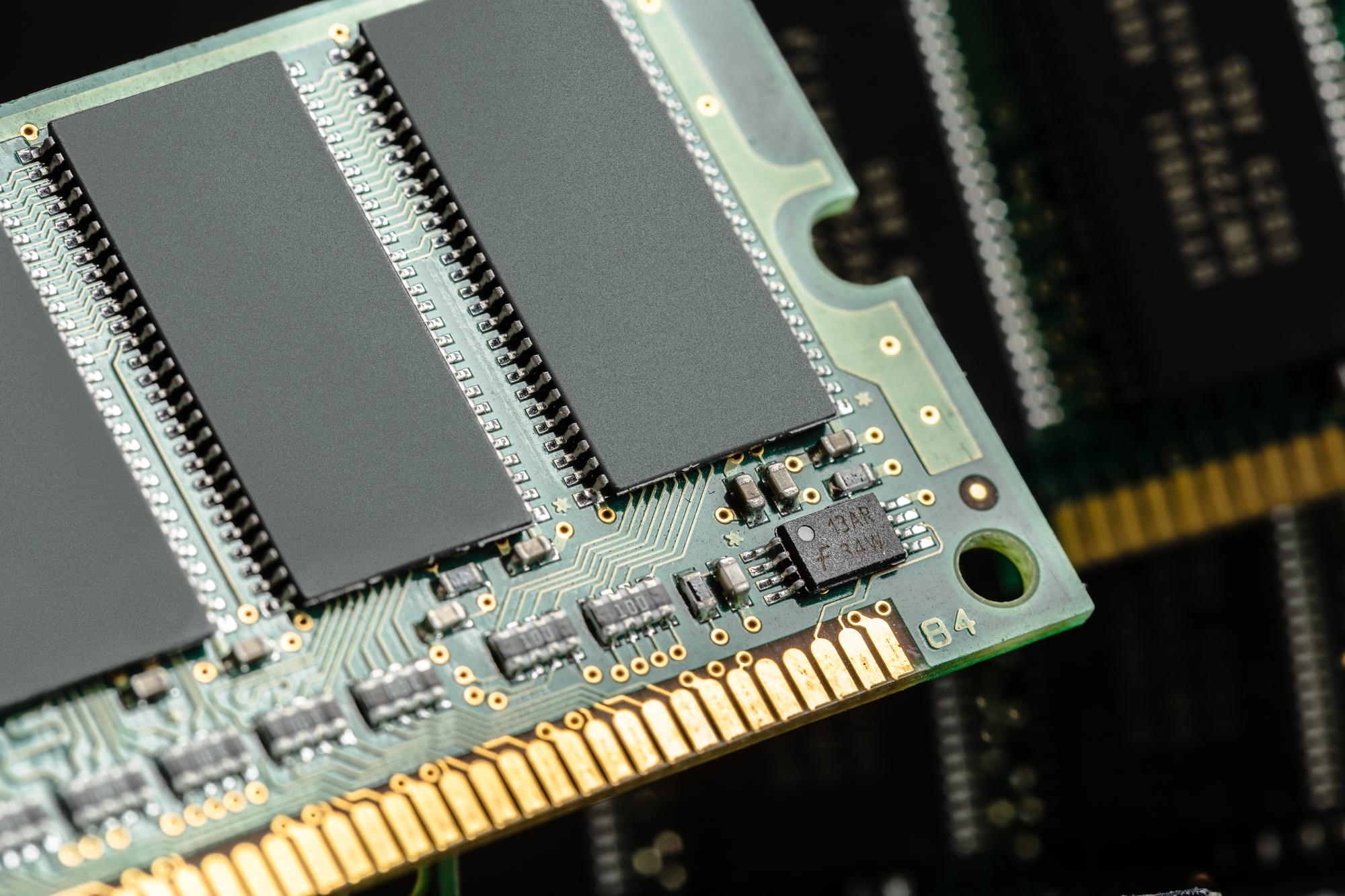

A corrida pela supremacia na inteligência artificial atingiu um novo patamar, quase absurdo. Numa série de reuniões em Seul, a OpenAI fechou acordos preliminares com as gigantes sul-coreanas Samsung e SK Hynix com um objetivo que ameaça abalar toda a indústria de semicondutores: garantir uma produção de 900.000 wafers de memória DRAM por mês.

Este número, por si só, é impressionante, mas ganha uma nova dimensão quando colocado em perspetiva. O plano visa alimentar o colossal projeto Stargate da OpenAI e representa um volume de produção verdadeiramente avassalador.

Um número que abala a indústria de semicondutores

Para se ter uma ideia da escala, segundo dados da TechInsights, a capacidade de produção global de wafers de DRAM de 300 milímetros deverá atingir cerca de 2,25 milhões de unidades por mês em 2025. O objetivo da OpenAI, se concretizado, significaria que a empresa de Sam Altman consumiria sozinha perto de 39% de toda essa capacidade mundial.

Nenhum fabricante individual consegue atingir tal volume, o que explica a necessidade desta aliança estratégica. As reuniões em Seul contaram com a presença de Sam Altman, CEO da OpenAI, dos líderes dos conglomerados tecnológicos e do próprio presidente sul-coreano, Lee Jae-myung, demonstrando a importância do acordo para a ambição do país em tornar-se uma das três maiores potências globais em inteligência artificial.

O projeto Stargate e a fome insaciável da IA

Mas por que precisa a OpenAI de tanta memória? A resposta está na diferença fundamental entre usar e treinar um modelo de IA. Enquanto uma consulta a um chatbot como o ChatGPT ativa a infraestrutura de inferência, que é muito menos exigente, o treino de um sistema de nova geração requer milhares de chips a trabalhar em paralelo, cada um equipado com módulos de memória de alto desempenho.

É esta escala que multiplica a necessidade de servidores, sistemas de arrefecimento e energia elétrica, tornando a garantia de centenas de milhares de wafers por mês não um excesso, mas uma necessidade para assegurar o suporte material para a próxima geração de modelos de IA, como os que irão alimentar o projeto Stargate. Os acordos incluem também a participação da Samsung SDS, Samsung C&T e Samsung Heavy Industries no desenvolvimento e construção de novos centros de dados, com a SK Telecom a estudar a viabilidade de uma instalação no sudoeste do país.

Um ecossistema de gigantes e o divórcio da Microsoft

A trajetória da OpenAI tem sido fortemente ligada à Microsoft, que com um investimento inicial de mil milhões de dólares em 2019, e outro posterior de 10 mil milhões, garantiu o acesso à sua nuvem Azure, crucial para treinar os modelos que deram origem ao ChatGPT. No entanto, os movimentos mais recentes indicam uma mudança de rumo. A empresa de Sam Altman procura agora reduzir essa dependência, construindo infraestruturas sobre as quais tenha um controlo mais direto.

Este novo eixo com a Samsung e a SK Hynix junta-se a outras alianças de peso. A OpenAI já tem parcerias com a Oracle e o SoftBank para o desenvolvimento de cinco centros de dados. A NVIDIA, por sua vez, anunciou investimentos que podem chegar aos 100 mil milhões de dólares para dar acesso a sistemas de treino massivos.

Um caminho ambicioso mas com detalhes por definir

Apesar da escala monumental dos números anunciados pela OpenAI, é importante notar que muitos dos acordos firmados são, para já, cartas de intenção e memorandos de entendimento. Os detalhes concretos e os prazos de execução ainda não foram fechados.

Os riscos de um projeto desta magnitude são evidentes, desde possíveis estrangulamentos na produção de memória de alto desempenho à disponibilidade de energia para alimentar instalações que consomem vários gigawatts. O caminho é longo e complexo, mas a ambição da OpenAI para moldar o futuro da inteligência artificial ficou, mais uma vez, bem clara.

Nenhum comentário

Seja o primeiro!