O maior desafio de trabalhar com modelos de aprendizagem profunda é perceber o motivo pelo qual tomam certas decisões. Seja a constante afinação política do Grok da xAI, a tendência do ChatGPT para respostas formatadas de forma complacente, ou as habituais alucinações, navegar por uma rede neuronal com milhares de milhões de parâmetros não é uma tarefa simples.

A Guide Labs, uma startup de São Francisco fundada pelo diretor executivo Julius Adebayo e pela diretora científica Aya Abdelsalam Ismail, apresenta agora uma resposta direta a este problema. A empresa disponibilizou em código aberto o Steerling-8B, um grande modelo de linguagem com 8 mil milhões de parâmetros, desenvolvido com uma arquitetura desenhada para tornar as suas ações facilmente interpretáveis, estando disponível no repositório da Guide Labs.

A engenharia por trás da transparência

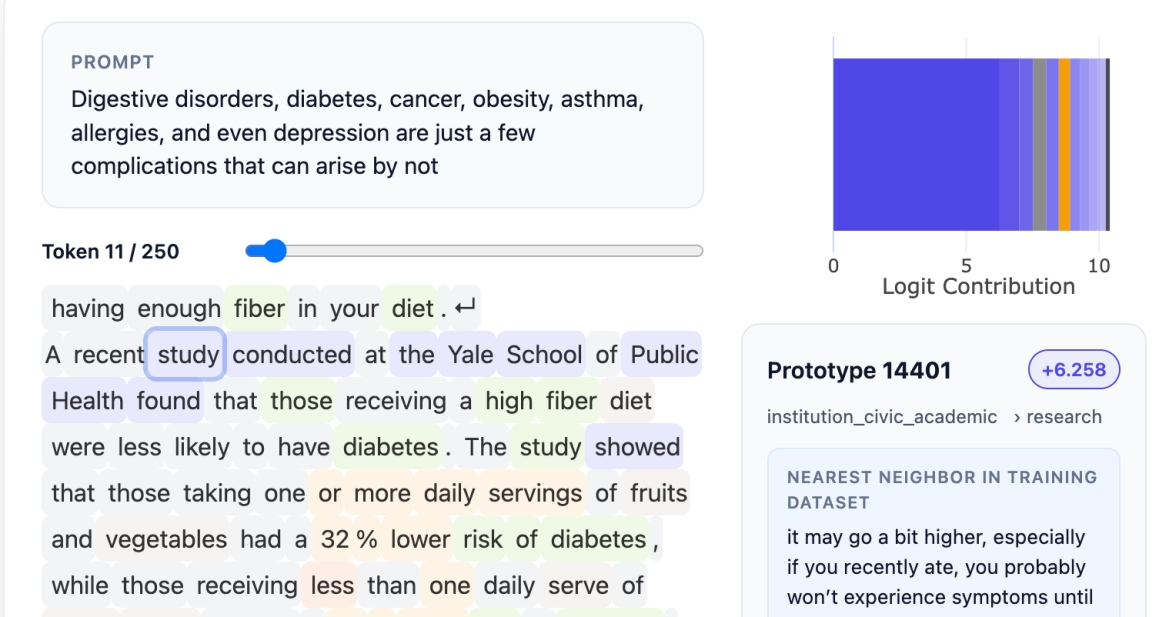

Cada token produzido pelo novo modelo pode ser rastreado até às suas origens exatas nos dados de treino. Na prática, isto permite determinar imediatamente os materiais de referência para os factos citados pela inteligência artificial ou compreender de que forma o sistema interpreta conceitos complexos, como o humor ou a identidade de género.

Julius Adebayo explicou à TechCrunch que os modelos atuais até permitem ativar ou desativar a codificação de características específicas, mas o processo é extremamente frágil. A pesquisa que originou esta abordagem começou no MIT, culminando num estudo amplamente citado em 2020 que demonstrava a falta de fiabilidade dos métodos existentes para analisar redes neuronais.

A solução da Guide Labs passou por criar uma nova forma de construir a arquitetura do software. Os programadores inserem uma camada de conceitos no modelo que organiza a informação em categorias facilmente rastreáveis. A empresa inverte assim a abordagem tradicional de tentar fazer "neurociência num modelo" já criado, optando por arquitetar a tecnologia de raiz para que o seu funcionamento seja claro desde o primeiro momento.

Aplicações práticas e expansão no mercado

Apesar desta estrutura altamente controlada, o modelo mantém os comportamentos emergentes que tornam a tecnologia interessante. A equipa acompanha o que designa de "conceitos descobertos", onde o sistema consegue generalizar de forma autónoma sobre temas nos quais não foi diretamente treinado, como a computação quântica.

Esta arquitetura apresenta-se como uma necessidade transversal à indústria. Para produtos direcionados ao consumidor, permite aos programadores bloquear o uso de materiais protegidos por direitos de autor ou controlar as respostas sobre temas sensíveis. Indústrias reguladas, como o setor financeiro, podem utilizar a tecnologia para garantir que os sistemas avaliam processos de crédito baseados em históricos financeiros sem a influência de vieses raciais. O meio científico também beneficia, especialmente em áreas de sucesso como o desdobramento de proteínas, onde os investigadores exigem perceber as lógicas do software para validar os resultados.

O Steerling-8B consegue atingir 90% da capacidade dos modelos equivalentes no mercado, utilizando um menor volume de informação de treino graças à sua estrutura eficiente. A empresa, que emergiu da incubadora Y Combinator e levantou uma ronda de investimento de 9 milhões de dólares (cerca de 8,5 milhões de euros) liderada pela Initialized Capital em novembro de 2024, planeia focar os seus esforços na construção de um modelo de maiores dimensões e na disponibilização de acesso por API para os utilizadores.

Nenhum comentário

Seja o primeiro!