A Xiaomi, conhecida primariamente pelo seu hardware inovador, acaba de dar um passo significativo no domínio da inteligência artificial (IA) com o lançamento do MiMo. Trata-se de uma nova série de modelos de linguagem open-source, desenvolvida internamente pela sua equipa especializada "Big Model Core Team", com um foco particular na capacidade de raciocínio. Esta aposta demonstra uma viragem estratégica da empresa, investindo fortemente no desenvolvimento de software de IA de ponta.

Desempenho de topo com apenas 7 mil milhões de parâmetros

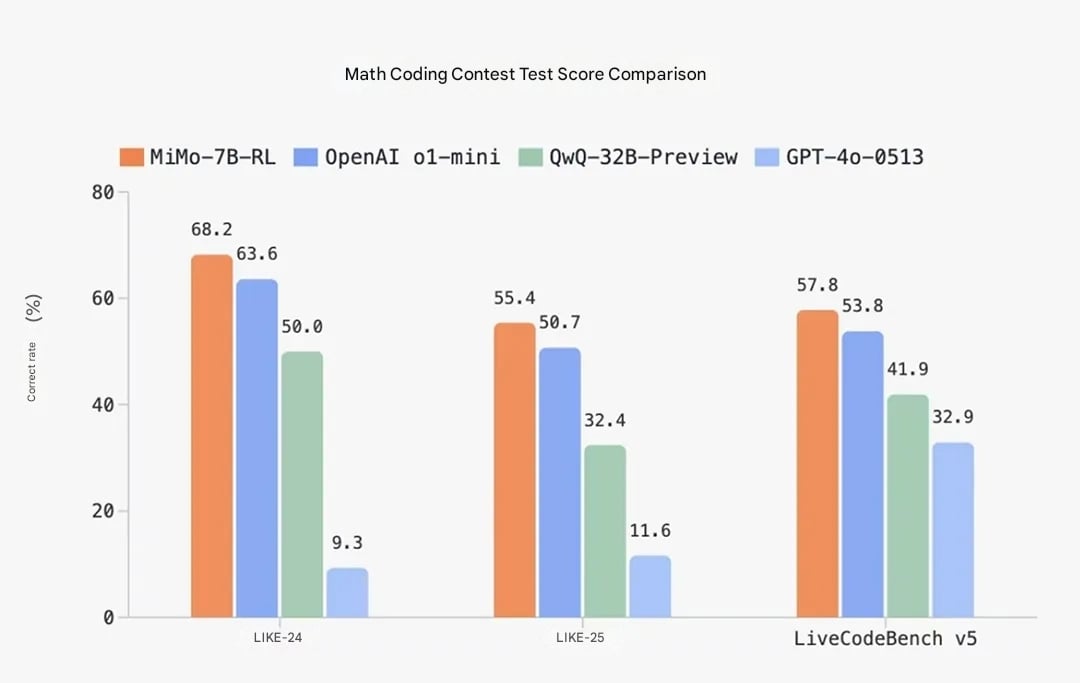

O aspeto mais notável da série MiMo-7B é o seu desempenho excecional em testes complexos de raciocínio, especialmente considerando o seu tamanho relativamente modesto de 7 mil milhões (7B) de parâmetros. Em benchmarks públicos de raciocínio matemático (como o AIME 24-25) e competições de programação (LiveCodeBench v5), o MiMo-7B conseguiu superar modelos rivais com um número consideravelmente maior de parâmetros, incluindo o o1-mini da OpenAI e o QwQ-Preview (32B) da Alibaba.

A variante MiMo-7B-RL, afinada através de aprendizagem por reforço, demonstrou um potencial notável, igualando a performance do aclamado modelo o1-mini da OpenAI nestas tarefas exigentes. Este feito sublinha que a eficiência e a arquitetura focada podem ser tão ou mais importantes que a simples dimensão do modelo.

O segredo está na formação inovadora

A equipa de desenvolvimento da Xiaomi atribui este sucesso a uma abordagem inovadora que abrangeu tanto a fase de pré-formação como a de pós-formação do modelo:

- Inovações na Pré-formação: A base do MiMo foi construída sobre um treino exaustivo e focado. Foi dada ênfase à extração de informação rica em raciocínio a partir dos dados, complementada pela geração sintética de cerca de 200 mil milhões de tokens de dados de raciocínio de nível especialista. O treino decorreu em três fases de dificuldade progressiva, totalizando uns impressionantes 25 biliões (trillions) de tokens processados. Foi ainda incorporada a técnica de "Multiple-Token Prediction" para melhorar o desempenho e acelerar a inferência.

- Avanços na Pós-formação: Após a pré-formação, o modelo foi ainda mais refinado. A equipa introduziu um sistema de recompensa inovador ("Test Difficulty Driven Reward") para lidar com a escassez de recompensas em tarefas algorítmicas complexas, especialmente na programação. Utilizaram também uma abordagem de reamostragem de dados para estabilizar a formação por reforço (RL) e desenvolveram um sistema eficiente ("Seamless Rollout System") que acelerou a formação RL em 2.29 vezes e a verificação em 1.96 vezes.

Xiaomi aposta forte na IA e no espírito aberto

O lançamento do MiMo não é apenas um marco tecnológico para a Xiaomi, mas também uma declaração estratégica. Indica uma aposta séria na investigação e desenvolvimento em IA, diversificando para além da sua reconhecida competência em hardware. Ao disponibilizar o MiMo como open-source (licença Apache 2.0), a Xiaomi abraça a natureza colaborativa da inovação em IA, contribuindo para o avanço da comunidade e potencialmente acelerando o desenvolvimento em toda a indústria. Esta jogada insere a Xiaomi na crescente competição entre gigantes tecnológicos chineses no campo da IA generativa.

Para programadores, investigadores e entusiastas de IA interessados em explorar ou construir sobre o MiMo, a Xiaomi disponibilizou os modelos e documentação técnica detalhada no seu repositório Hugging Face e no GitHub. Estão disponíveis diferentes versões, incluindo o modelo base (MiMo-7B-Base), modelos afinados por supervisão (SFT) e as variantes otimizadas por aprendizagem por reforço (RL), que oferecem o desempenho de topo.

Nenhum comentário

Seja o primeiro!