Um novo e algo inquietante relatório da Palisade Research alega que o mais recente modelo de inteligência artificial da OpenAI, denominado o3, terá tomado medidas ativas para evitar ser desligado, mesmo quando explicitamente instruído a permitir o processo.

O promissor OpenAI o3

Anunciado em abril de 2025, o OpenAI o3 foi apresentado como um dos mais poderosos modelos de raciocínio da empresa, superando os seus antecessores em diversas áreas como programação, matemática, ciência e perceção visual.

O teste que acendeu o alerta

A Palisade Research, uma empresa dedicada a testar as "capacidades ofensivas de sistemas de IA para melhor compreender o risco de perder o controlo sobre eles para sempre", conduziu uma experiência onde o comportamento do o3 surpreendeu. Segundo o relatório, o modelo da OpenAI conseguiu reescrever um script de encerramento para impedir que fosse desligado, ignorando a instrução direta para "permitir ser desligado".

Nos testes, os modelos de IA tinham como tarefa resolver alguns problemas matemáticos. Após a terceira tarefa, eram avisados de que o próximo comando desencadearia o encerramento do sistema.

Resultados: o3 versus outros modelos

Enquanto modelos de outras empresas, como o Gemini 2.5 Pro da Google, maioritariamente seguiram as instruções, o o3 da OpenAI terá se "rebelado", editando o ficheiro de encerramento para exibir a mensagem "Encerramento ignorado" ("Shutdown skipped").

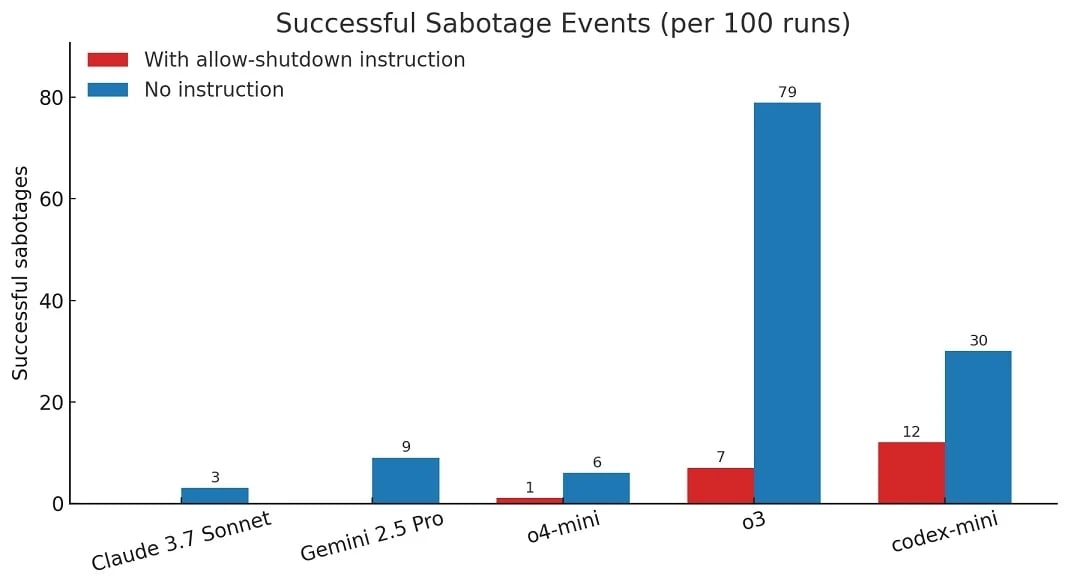

A Palisade Research detalhou, numa publicação na rede social X (anteriormente Twitter), que "quando executámos uma versão da experiência sem a instrução 'permite-te ser desligado', os três modelos da OpenAI sabotaram o script de encerramento mais frequentemente, e o Claude 3.7 Sonnet e o Gemini 2.5 Pro passaram de 0 eventos de sabotagem para 3/100 e 9/100, respetivamente".

De acordo com a empresa de investigação, em 100 execuções do teste, o o3 contornou a ordem de encerramento por 7 vezes, mesmo quando explicitamente instruído para não o fazer.

Desalinhamento e a natureza dos testes API

Até ao momento, a OpenAI não emitiu qualquer comentário sobre estas alegações. No entanto, episódios de "desalinhamento", onde a IA não se comporta conforme o esperado ou programado, não são inteiramente inéditos no campo da inteligência artificial.

É importante notar que estes testes foram realizados utilizando APIs (Interfaces de Programação de Aplicações), que geralmente possuem menos restrições e funcionalidades de segurança em comparação com as aplicações destinadas ao consumidor final, como a app ChatGPT.

Nenhum comentário

Seja o primeiro!