Nos últimos meses temos verificado casos onde a IA generativa foi usada para fins abusivos, com formas de contornar algumas das medidas de proteção implementadas nos sistemas para prevenir a criação de conteúdos maliciosos ou enganadores.

Um dos exemplos mais recentes, e marcantes, encontra-se quando imagens deepfake da cantora Taylor Swift começaram a surgir pela internet, aparentemente criadas via o Microsoft Designer, com recurso a IA.

Para prevenir novamente casos idênticos, a Microsoft revelou hoje uma nova funcionalidade para o Azure OpenAI Service. Com a nova funcionalidade, os utilizadores da plataforma da Azure para IA generativa podem ter um maior controlo e segurança contra pedidos potencialmente enganadores, ou que se foquem em contornar as proteções da IA.

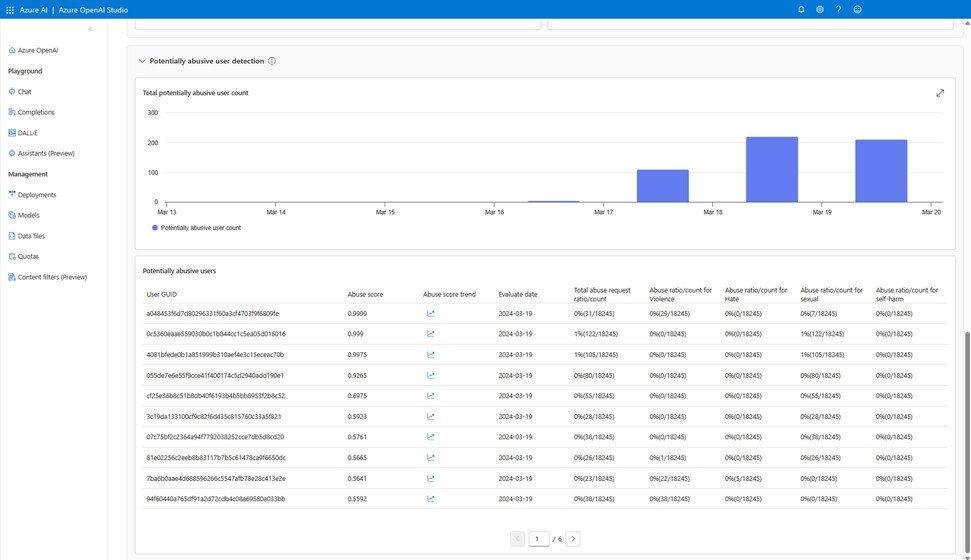

Um novo painel do sistema da Microsoft permite aceder rapidamente a um sistema de monitorização, onde se pode identificar casos onde os utilizadores tenham tentado abusar da IA generativa.

Segundo a Microsoft, este painel pode apresentar informação útil para ajudar os administradores dos sistemas a identificar casos abusivos, onde os utilizadores da plataforma tenham tentado contornar as medidas de proteção implementadas.

Com base nestes dados, as empresas podem depois aplicar medidas mais restritivas na criação de conteúdos usando a IA.

A novidade encontra-se disponível gratuitamente para todos os clientes do Azure OpenAI, sendo que deve expandir-se para várias regiões durante os próximos meses.

Nenhum comentário

Seja o primeiro!